本篇目录:

- 1、lstm和gru哪个好

- 2、快速理解RNN(LSTM,GRU)结构原理

- 3、几种常见的循环神经网络结构RNN、LSTM、GRU

- 4、GRU与LSTM的区别是什么?

- 5、lstm和gru结构的再理解

lstm和gru哪个好

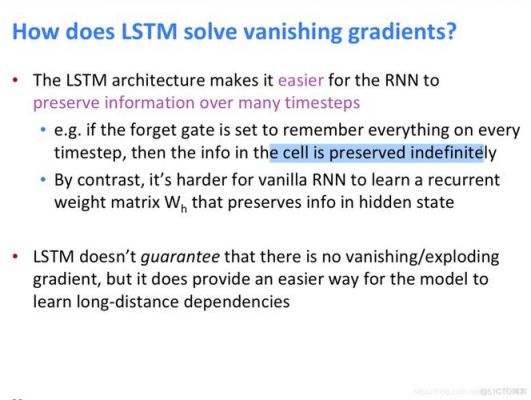

相比于LSTM,GRU的计算复杂度更低,因为它没有单元状态,也没有遗忘门,但是它的表现仍然相当不错。实践中,GRU和LSTM都有广泛的应用,具体使用哪种结构取决于具体的应用场景和数据特征。

相比之下,使用GRU单元会更加简单。QRNN(Quasi-Recurrent Neural Networks) 单元是一种RNN模型的基础单元,它比LSTM单元速度更快。QRNN单元发表于2016年。它使用卷积操作替代传统的循环结构,其网络结构介于RNN与CNN之间。

GRU 门控循环单元(gated recurrent unit,GRU)是LSTM网络的一种效果很好的变体,它较LSTM网络的结构更加简单,而且效果也很好,因此也是当前非常流行的一种网络。

因为gru参数更少,所以gru训练起来比lstm更简单。 但是, 这两种cell最后的结果差不了太多! 用的时候不必纠结选择哪种结构。好了,lstm和gru说完了,下次来点新玩意,seq2seq和attention。

快速理解RNN(LSTM,GRU)结构原理

1、递归神经网络(RNNs)是一类常用的序列数据人工神经网络。

2、lstm结构理解完了,其实gru结构的理解方式基本一致。还是那张图 这里和lstm不同的是:如果r[t] = 1,z[t] = 1,那么gru和普通rnn的cell就是一样的。因为gru参数更少,所以gru训练起来比lstm更简单。

3、LSTM单元与GRU单元是RNN模型中最常见的单元,其内容由输入门、忘记门、和输出门三种结构组合而成。LSTM单元与GRU单元的作用几乎相同,唯一不同的是:相比之下,使用GRU单元会更加简单。

几种常见的循环神经网络结构RNN、LSTM、GRU

1、相比于卷积神经网络等前馈神经网络,循环神经网络由于具备对序列顺序信息的刻画能力,往往能得到更准确的结果。

2、RNN模型的基础结构是单元,其中比较常见的有LSTM单元,GRU单元等,它们充当了RNN模型中的基础结构部分。使用单元搭建出来的RNN模型会有更好的拟合效果。

3、递归神经网络(RNNs)是一类常用的序列数据人工神经网络。

4、递归神经网络本质是学习一个函数,因此有输入和输出层的概念,而玻尔兹曼机的用处在于学习一组数据的“内在表示”,因此其没有输出层的概念。 递归神经网络各节点链接为有向环,而玻尔兹曼机各节点连接成无向完全图。

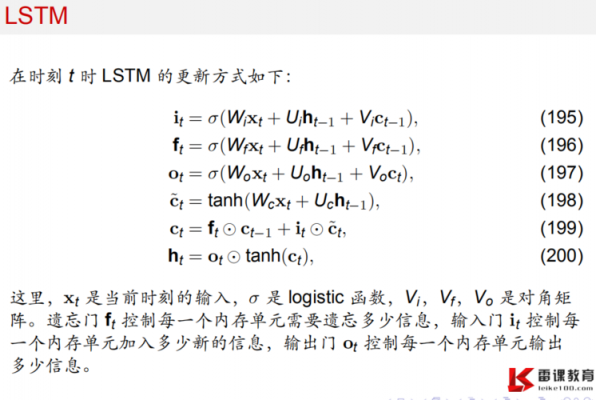

5、LSTM相比RNN hidden status还引入了细胞状态来记录信息。

6、.查询方式、2.中断方式、3.DMA方式。循环神经网络(RNN/recurrentneuralnetwork)是一类人工神经网络,其可以通过为网络添加额外的权重来在网络图(networkgraph)中创建循环,以便维持一个内部状态。

GRU与LSTM的区别是什么?

LSTM单元与GRU单元的作用几乎相同,唯一不同的是:相比之下,使用GRU单元会更加简单。QRNN(Quasi-Recurrent Neural Networks) 单元是一种RNN模型的基础单元,它比LSTM单元速度更快。QRNN单元发表于2016年。

这里和lstm不同的是:如果r[t] = 1,z[t] = 1,那么gru和普通rnn的cell就是一样的。因为gru参数更少,所以gru训练起来比lstm更简单。 但是, 这两种cell最后的结果差不了太多! 用的时候不必纠结选择哪种结构。

GRU 门控循环单元(gated recurrent unit,GRU)是LSTM网络的一种效果很好的变体,它较LSTM网络的结构更加简单,而且效果也很好,因此也是当前非常流行的一种网络。

由于GRU参数更少,收敛快,通常在数据集够大的情况下,选择LSTM效果应该会更好。

图2:LSTM 示意动画 注意,单元状态的维度与隐藏状态的维度相同。

lstm和gru结构的再理解

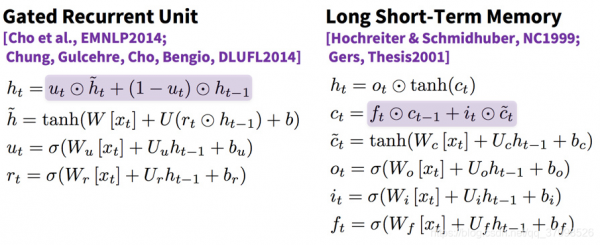

1、GRU (Gated Recurrent Unit)和LSTM (Long Short-Term Memory)是两种用于解决循环神经网络中梯度消失和梯度爆炸问题的常用结构。它们之间的主要区别在于门控单元的数量和计算复杂度。

2、LSTM单元与GRU单元是RNN模型中最常见的单元,其内容由输入门、忘记门、和输出门三种结构组合而成。LSTM单元与GRU单元的作用几乎相同,唯一不同的是:相比之下,使用GRU单元会更加简单。

3、GRU是在LSTM上进行简化而得到的,GRU的网络结构如下所示:Zt代表更新门,更新门的作用类似于LSTM中的遗忘门和输入门,它能决定要丢弃哪些信息和要添加哪些新信息。 Rt代表重置门,重置门用于决定丢弃先前信息的程度。

4、GRU 门控循环单元(gated recurrent unit,GRU)是LSTM网络的一种效果很好的变体,它较LSTM网络的结构更加简单,而且效果也很好,因此也是当前非常流行的一种网络。

5、GRU是具有不同门的LSTM。 听起来很简单,但缺少输出门可以更容易基于具体输入重复多次相同的输出,目前此模型在声音(音乐)和语音合成中使用得最多。

6、该结构如下图所示。 一种比其他形式变化更为显著的LSTM变式是由 Cho, et al. (2014) 提出的门循环单元(GRU)。它将忘记门和输入门合并成一个新的门,称为更新门。GRU还有一个门称为重置门。

到此,以上就是小编对于lstm gru哪个好的问题就介绍到这了,希望介绍的几点解答对大家有用,有任何问题和不懂的,欢迎各位老师在评论区讨论,给我留言。

微信扫一扫打赏

微信扫一扫打赏